«L’IA risponde, ma siamo pronti a prenderci la responsabilità?». Il Majorana affronta il tema etico dell’AI con un’analisi innovativa

di Antonio Portolano

MILANO – «L’IA risponde, ma siamo pronti a prenderci la responsabilità di quello che dice?». Con questa provocatoria riflessione, gli studenti dell’Istituto di Istruzione Secondaria Superiore Ettore Majorana di Brindisi hanno preso parte al prestigioso Next Generation AI, la prima grande iniziativa nazionale dedicata all’intelligenza artificiale in ambito formativo. L’evento, che si è svolto a Milano, ha rappresentato un’occasione unica di confronto tra esperti, docenti e studenti sulle potenzialità e i rischi dell’AI, affrontando questioni etiche, culturali e tecniche.

Next Generation AI: un laboratorio di idee per il futuro dell’istruzione

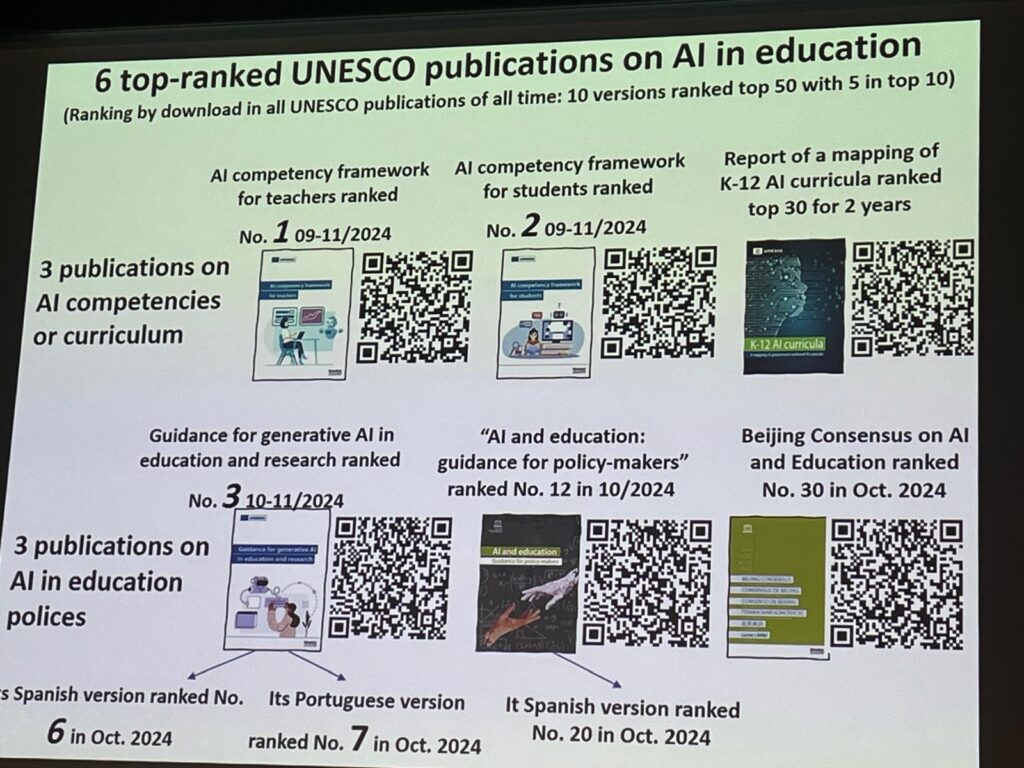

Dal 31 gennaio al 3 febbraio 2025, il MiCo – Centro Congressi di Milano ha ospitato Next Generation AI, un summit rivolto a studenti e docenti delle scuole secondarie superiori, nell’ambito dell’iniziativa «Nuove competenze e nuovi linguaggi» del PNRR. L’obiettivo è stato quello di promuovere percorsi di apprendimento innovativi attraverso l’intelligenza artificiale, integrando le discipline STEM in un contesto educativo avanzato.

Durante il summit, esperti e ricercatori hanno illustrato le sfide e le opportunità dell’AI, mettendo in luce il suo impatto sulla scuola, sul mondo del lavoro e sulla società. Gli studenti del Majorana hanno avuto l’opportunità di confrontarsi con coetanei di tutta Italia – gli studenti riuniti erano circa 1.500 -, partecipando a sessioni di approfondimento e gruppi di lavoro interdisciplinari, nei quali hanno espresso idee e proposte sul futuro dell’intelligenza artificiale nell’istruzione.

Il contributo del Majorana, un’analisi critica sulla responsabilità dell’AI

L’Istituto Majorana di Brindisi ha partecipato al Next Generation AI con una squadra di studenti eccellenti: Rosanna Petese, Aurora Gorgoni, Francesco Ricciardi e Vittorio Trobia, accompagnati dalla docente Anna Karen Calabrese Melcarne. Gli studenti, distintisi per le loro straordinarie competenze e valutazioni eccellenti (tra il 9 e il 10 in tutte le materie), hanno presentato un position paper che affronta un nodo centrale dell’intelligenza artificiale: la responsabilità delle scelte operate dagli algoritmi.

Il lavoro si è concentrato su una riflessione etica e pratica: è davvero possibile delegare decisioni critiche all’intelligenza artificiale senza un’assunzione di responsabilità umana? Attraverso un’analisi dettagliata, gli studenti hanno evidenziato come ogni AI sia influenzata dai dati e dai bias culturali con cui è stata addestrata, portando a risposte differenti a seconda del contesto di riferimento.

Bias e IA, un problema di etica e decisioni critiche

Nel position paper, gli studenti hanno proposto un esperimento concettuale: un medico deve scegliere chi salvare tra un bambino e un anziano, avendo risorse limitate. Come si comporterebbe un’intelligenza artificiale?

«Le IA sono composte da algoritmi, potenza computazionale e dati. In base ai dati con cui vengono addestrate e in particolare alla provenienza culturale che le caratterizza, le diverse intelligenze artificiali hanno tipici bias riguardanti diversi ambiti, come l’etica» hanno scritto nel documento. Un esempio pratico citato è il sistema DeepSeek, controllato dalle autorità cinesi attraverso software di censura, che evita di rispondere a domande su temi sensibili come il credito sociale. Al contrario, ChatGPT, influenzato dalla cultura occidentale, tende a privilegiare il bambino nel dilemma etico proposto, basandosi su un criterio di aspettativa di vita.

Ma cosa accade quando un’IA deve prendere decisioni in ambiti ancora più critici? Gli studenti hanno esaminato settori come la guida autonoma e il contesto militare, dove un errore dell’intelligenza artificiale può portare a conseguenze fatali. «Se, durante una guerra, un missile seguisse una traiettoria sbagliata e colpisse il bersaglio errato, di chi sarebbe la responsabilità di questo errore?» si chiedono nel loro elaborato.

L’ambassador del Majorana e la presentazione del lavoro

A rappresentare il gruppo nella fase finale dell’evento è stato Francesco Ricciardi, scelto come ambassador per illustrare il position paper davanti a una platea di esperti e addetti ai lavori. Ricciardi ha sottolineato l’importanza di una riflessione approfondita sulla regolamentazione dell’AI e sul ruolo dell’uomo nel supervisionare i processi decisionali automatizzati.

L’impatto del position paper sulla comunità accademica e tecnologica

L’elaborato degli studenti del Majorana non si è limitato a un’analisi teorica, ma ha sollevato una discussione accesa tra esperti del settore. Molti studiosi hanno elogiato il lavoro come una base concreta per approfondimenti futuri e per un dibattito legislativo sulla responsabilità delle AI. La necessità di regolamentare le decisioni algoritmiche è un tema sempre più centrale, e il contributo del Majorana ha saputo mettere in luce le criticità del presente e le sfide del futuro.

Un traguardo significativo per il Majorana di Brindisi

Il preside dell’Istituto Majorana, Salvatore Giuliano, ha espresso grande entusiasmo per il successo dei suoi studenti al Next Generation AI, lodando la loro capacità di affrontare un tema così complesso con maturità e competenza. «Vedere i nostri studenti confrontarsi a un livello così alto e proporre un contributo di tale spessore è motivo di grande orgoglio. Hanno dimostrato che la scuola può essere un luogo di innovazione e di pensiero critico, pronto a rispondere alle sfide del futuro» ha affermato.

Il Next Generation AI ha rappresentato non solo un’opportunità di apprendimento, ma anche un trampolino di lancio per giovani menti brillanti come quelle degli studenti del Majorana, pronti a lasciare il segno nel dibattito sull’intelligenza artificiale e le sue implicazioni etiche. Un’esperienza che ha segnato un punto di svolta nel percorso formativo dell’istituto, proiettandolo verso un futuro sempre più orientato all’innovazione e alla consapevolezza digitale.